Περιεχόμενο

Ερ:

Γιατί συχνά τα τεχνητά επαναλαμβανόμενα νευρικά δίκτυα είναι δύσκολο να εκπαιδευτούν;

ΕΝΑ:

Η δυσκολία κατάρτισης τεχνητών επαναλαμβανόμενων νευρωνικών δικτύων έχει να κάνει με την πολυπλοκότητά τους.

Ένας από τους απλούστερους τρόπους για να εξηγηθεί γιατί τα επαναλαμβανόμενα νευρωνικά δίκτυα είναι δύσκολο να εκπαιδευτούν είναι ότι δεν είναι ανεστραμμένα νευρωνικά δίκτυα.

Στα τροφοδοτικά νευρωνικά δίκτυα, τα σήματα κινούνται μόνο με έναν τρόπο. Το σήμα μετακινείται από ένα στρώμα εισόδου σε διάφορα κρυφά στρώματα και προς τα εμπρός, στο στρώμα εξόδου ενός συστήματος.

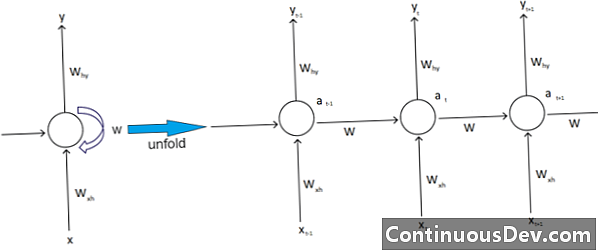

Αντιθέτως, τα επαναλαμβανόμενα νευρικά δίκτυα και άλλοι διαφορετικοί τύποι νευρωνικών δικτύων έχουν πιο πολύπλοκες κινήσεις σημάτων. Τα επαναλαμβανόμενα νευρωνικά δίκτυα, που ταξινομούνται ως δίκτυα "ανατροφοδότησης", μπορούν να έχουν σήματα που μετακινούνται προς τα εμπρός και προς τα πίσω και ενδέχεται να περιέχουν διάφορους "βρόχους" στο δίκτυο όπου οι αριθμοί ή οι τιμές διοχετεύονται στο δίκτυο. Οι εμπειρογνώμονες συσχετίζουν αυτό με την πλευρά των επαναλαμβανόμενων νευρωνικών δικτύων που σχετίζονται με τη μνήμη τους.

Επιπλέον, υπάρχει ένας άλλος τύπος πολυπλοκότητας που επηρεάζει τα επαναλαμβανόμενα νευρωνικά δίκτυα. Ένα εξαιρετικό παράδειγμα αυτού είναι στον τομέα της επεξεργασίας φυσικής γλώσσας.

Στην εξελιγμένη επεξεργασία φυσικής γλώσσας, το νευρικό δίκτυο πρέπει να είναι σε θέση να θυμάται τα πράγματα. Πρέπει να λαμβάνει εισροές και στο con, πάρα πολύ. Ας υποθέσουμε ότι υπάρχει ένα πρόγραμμα που θέλει να αναλύσει ή να προβλέψει μια λέξη μέσα σε μια πρόταση άλλων λέξεων. Μπορεί να υπάρχει, για παράδειγμα, ένα σταθερό μήκος πέντε λέξεων για να αξιολογηθεί το σύστημα. Αυτό σημαίνει ότι το νευρωνικό δίκτυο πρέπει να έχει εισόδους για κάθε μία από αυτές τις λέξεις, μαζί με την ικανότητα να "θυμάται" ή να εκπαιδεύει στο con των λέξεων αυτών. Για αυτούς και για άλλους παρόμοιους λόγους, τα επαναλαμβανόμενα νευρωνικά δίκτυα έχουν τυπικά αυτές τις μικρές κρυφές θηλιές και ανατροφοδοτήσεις στο σύστημα.

Οι εμπειρογνώμονες θρηνούν ότι αυτές οι επιπλοκές καθιστούν δύσκολη την κατάρτιση των δικτύων. Ένας από τους πιο συνηθισμένους τρόπους για να εξηγήσουμε αυτό είναι να αναφέρουμε το έκρηξη και την εξαφάνιση πρόβλημα κλίση. Ουσιαστικά, τα βάρη του δικτύου είτε θα οδηγήσουν σε εκρηκτικές ή εξαφανισμένες τιμές με μεγάλο αριθμό περασμάτων.

Ο πρωτοπόρος του νευρικού δικτύου Geoff Hinton εξηγεί αυτό το φαινόμενο στο διαδίκτυο λέγοντας ότι οι πίσω γραμμικές περάσματα θα προκαλέσουν μικρότερα βάρη για να συρρικνωθούν εκθετικά και μεγαλύτερα βάρη για να εκραγούν.

Το πρόβλημα αυτό, συνεχίζει, χειροτερεύει με μεγάλες ακολουθίες και πιο πολυάριθμα χρονικά βήματα, στα οποία τα σήματα αναπτύσσονται ή αποσυντίθενται. Η αρχικοποίηση του βάρους μπορεί να βοηθήσει, αλλά αυτές οι προκλήσεις είναι ενσωματωμένες στο επαναλαμβανόμενο μοντέλο νευρωνικού δικτύου. Theres θα είναι πάντα εκείνο το ζήτημα που συνδέονται με την ιδιαίτερη σχεδίαση και την κατασκευή τους. Ουσιαστικά, ορισμένοι από τους πιο πολύπλοκους τύπους νευρωνικών δικτύων αψηφούν πραγματικά την ικανότητά μας να τα διαχειριζόμαστε εύκολα. Μπορούμε να δημιουργήσουμε μια πρακτικά απεριόριστη πολυπλοκότητα, αλλά συχνά βλέπουμε πρόγνωση και προκλήσεις κλιμάκωσης να αυξηθούν.